아직도 ChatGPT와 LLM의 원리를 모르신다면 클릭!

|

2025-01-09 12:18

|

조회수 377

#인공지능 #딥러닝 #트랜스포머 #언어모델 #GPT #myip

[주요 목차]

목차1 📚 최GPT와 LM의 이해

목차2 🤖 트랜스포머 모델의 구조

목차3 🧠 언어 모델의 양대 산맥, 버트와 GPT

목차4 🔄 파인튜닝과 로라 기법

목차5 🔗 공식사이트 및 추가 리소스

인공지능의 발전은 이제 우리 일상에서 빼놓을 수 없는 요소가 되었습니다. 특히, 언어 모델의 발달은 자연어 처리 분야에 혁신을 가져오고 있으며, 다양한 분야에서 활용되고 있습니다. 이번 블로그에서는 인공지능과 딥러닝의 핵심 요소인 언어 모델과 트랜스포머에 대해 알아보겠습니다. 이를 통해 LM과 최GPT가 어떻게 작동하는지, 그리고 최신의 파인튜닝 기법인 로라에 대해서도 살펴볼 것입니다. 마지막으로, 관련 자료와 공식 사이트를 통해 더 깊이 있는 이해를 도모할 수 있도록 하겠습니다.

📚 최GPT와 LM의 이해

최GPT와 LM에 대한 이해는 인공지능 분야의 핵심입니다. LM은 대규모 언어 모델로, 인공지능이 자연어를 이해하고 생성할 수 있게 하는 기본 토대입니다. 이 LM의 한 형태인 최GPT는 특히 대화형 AI 모델로, 입력된 문장을 해석하고 적절한 답변을 생성하는 데 특화되어 있습니다. 이 과정에서 중요한 점은 언어 모델이 어떻게 데이터를 처리하고 패턴을 학습하는가입니다. 이러한 이해는 개발자뿐 아니라 일반 사용자에게도 매우 중요합니다. LM의 작동 원리는 데이터셋에서 패턴을 찾아내고, 이 패턴을 기반으로 새로운 데이터에서 결정을 내리는 프로그램으로 요약할 수 있습니다.

🤖 트랜스포머 모델의 구조

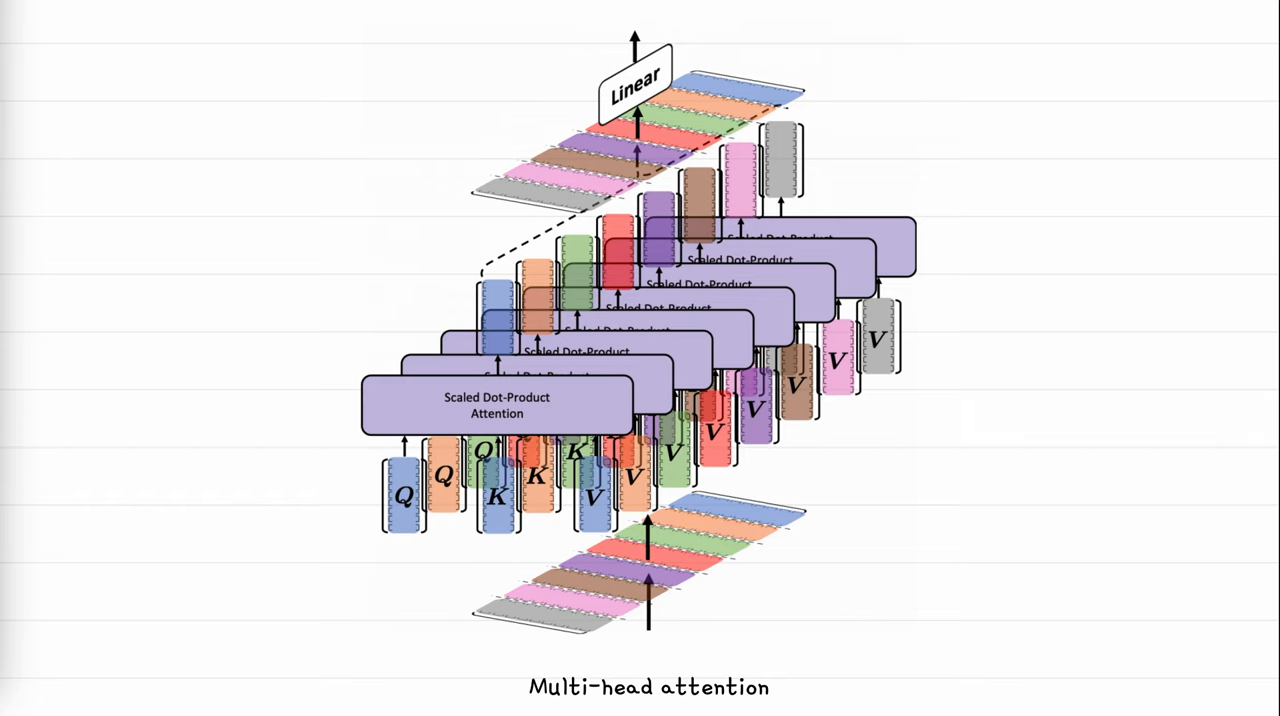

트랜스포머 모델은 현대 자연어 처리 기술의 혁신을 이끈 주역입니다. 이 모델은 특히 '어텐션 메커니즘'을 통해 문장 내 단어들 간의 관계를 파악합니다. 트랜스포머는 인코더와 디코더로 구성되어 있으며, 인코더는 입력 문장을 벡터로 변환하고, 디코더는 이 벡터를 기반으로 출력을 생성합니다. 이러한 구조는 기계 번역에서부터 다양한 NLP 태스크에 활용되고 있습니다. 트랜스포머의 어텐션 메커니즘은 단어 간의 상호 관계를 정밀하게 이해할 수 있게 하여, 모델이 보다 정확한 결과를 생성할 수 있게 합니다.

🧠 언어 모델의 양대 산맥, 버트와 GPT

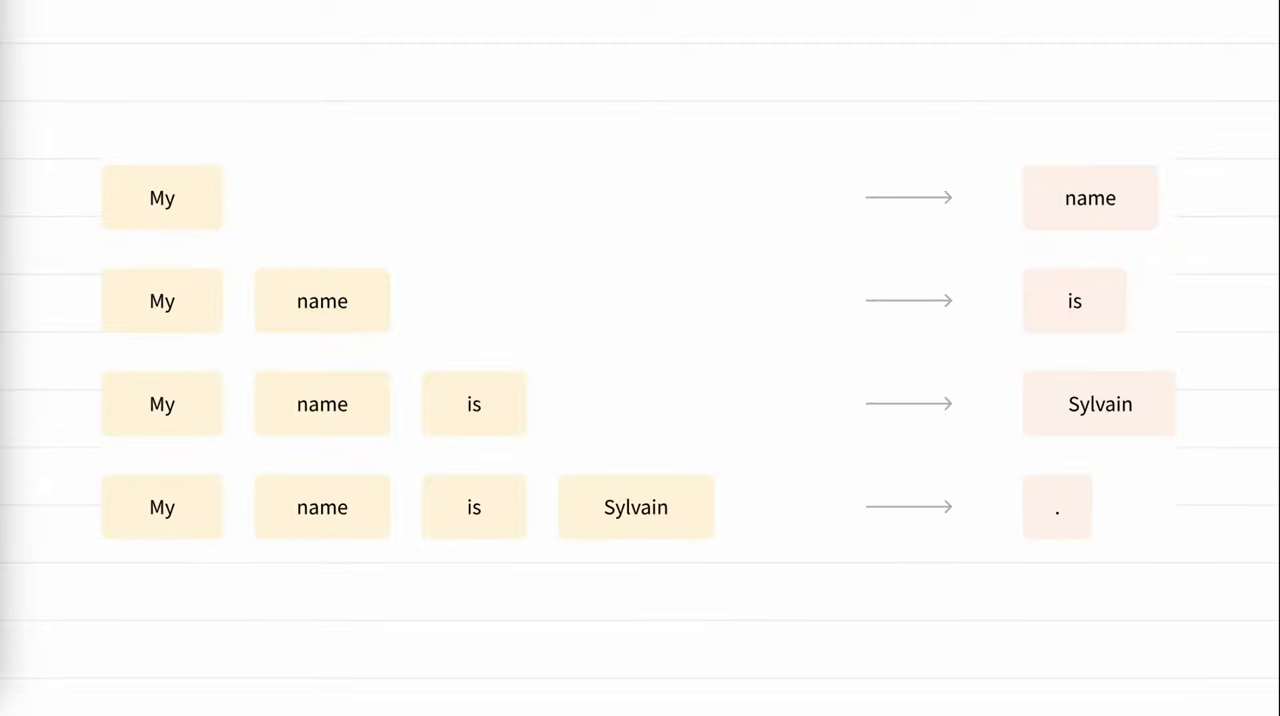

언어 모델의 발전은 버트와 GPT 두 모델을 통해 가속화되었습니다. 버트는 인코더 기반의 모델로, 문맥을 양방향으로 이해합니다. 반면 GPT는 디코더 기반으로, 다음 단어를 예측하는 데 특화되어 있습니다. 이 두 모델은 각각의 강점을 기반으로 다양한 응용 프로그램에서 사용되고 있으며, 현대 NLP 연구를 주도하고 있습니다. 버트는 텍스트 분류와 같은 작업에 적합하고, GPT는 텍스트 생성에 뛰어난 성능을 발휘합니다. 이들의 차이를 이해하는 것은 적절한 모델 선택에 있어서 매우 중요합니다.

🔄 파인튜닝과 로라 기법

파인튜닝은 특정 태스크에 맞춰 모델의 성능을 개선하는 과정입니다. 최근 주목받고 있는 로라 기법은 파인튜닝의 새로운 방법으로, 모델의 일부 가중치만 조정하여 효율적으로 성능을 향상시킵니다. 로라는 '낮은 계급 어댑테이션'의 약자로, 대규모 모델을 빠르고 경제적으로 조정할 수 있게 합니다. 이는 특히 자원이 제한된 환경에서 매우 유용하며, 최신 AI 어플리케이션에서 널리 사용되고 있습니다. 로라 기법을 통해 보다 적은 컴퓨팅 자원으로도 효과적인 파인튜닝이 가능합니다.

🔗 공식사이트 및 추가 리소스

더 깊이 있는 학습을 원하신다면, 아래 링크들을 통해 관련 자료를 확인해 보세요.

목록

글쓰기